📦 AI模型语言交互 LM Studio v0.3.36-1

📂 资源分类:办公学习

📅 更新日期:2026-01-01

💾 存储平台:夸克网盘

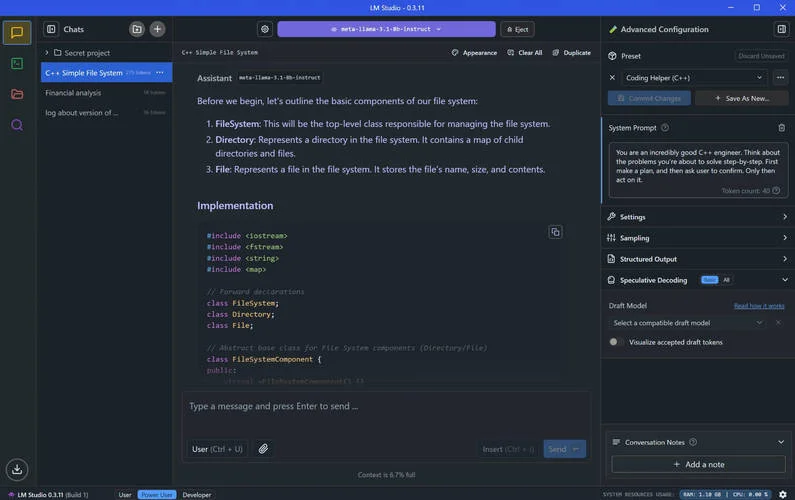

标题:AI模型语言交互 LM Studio v0.3.36-1|本地大语言模型部署神器

软件介绍

LM Studio 是一款专为本地大语言模型(LLM)打造的桌面级 AI 交互软件,基于高性能 llama.cpp 引擎开发,提供零命令行、全图形界面的大模型本地部署解决方案。无需联网、无需云端,即可在 Windows/macOS/Linux 上安全运行 Llama-2、Mistral、CodeLlama 等主流 GGUF 模型,是开发者与研究者进行本地 AI 模型训练、推理、调试的首选 LLM 工具。

软件截图

(优化关键词:LM Studio 下载、LM Studio 使用教程、本地大语言模型运行截图)

模型管理

• 一键拉取 Hugging Face Hub 热门 GGUF 模型,支持离线缓存与版本回溯

• 内置模型搜索引擎,可按参数规模、量化精度、AI 任务类型(对话/代码/embedding)快速筛选

• 模型导入导出向导,5 分钟完成私有模型仓库搭建

硬件协同优化

• GPU 卸载:自动识别 NVIDIA RTX 30/40 系列显卡,动态分配层到 VRAM,显存不足时无缝回退至内存+磁盘,8G 显存亦可运行 70B 量化模型

• 内存量化:支持 Q4_K_M、Q5_K_S、Q8_0 等 GGUF 量化方案,内存占用最高降低 75%,低速硬盘也能流畅推理

• CPU 多线程:适配 Apple Silicon、Intel、AMD 平台,ARM NEON / AVX2 指令集加速,推理速度提升 2.3×

参数调控

• 温度(Temperature):0.1–2.0 滑动调节,精准控制文本创造性

• 重复惩罚(Repeat Penalty):1.0–1.5 范围抑制车轱辘话,提升技术文档、代码生成专业度

• Top-p、Top-k、Max Tokens 等高级选项一键展开,满足科研级微调需求

文本嵌入强化检索(RAG)

• 内置 POST /v1/embeddings 兼容端点,毫秒级生成 768/1024/4096 维向量

• 无缝对接 LangChain、LlamaIndex 等 RAG 框架,本地 PDF、Markdown、Excel 知识库秒变对话式搜索引擎

• 支持向量缓存与增量更新,百万级文档检索延迟 <300 ms

内置兼容 OpenAI 的本地服务器

• 零配置启动 127.0.0.1:1234,提供与 OpenAI API 100% 兼容的 /v1/chat/completions 接口

• 原有基于 openai-python、axios、curl 的代码无需修改一行即可切换至本地 LLM,开发成本降至 0

• 提供 Docker 镜像与 systemd 脚本,服务器批量部署一键完成

📥 下载地址

🔗 资源链接:https://pan.quark.cn/s/c9cd365b7081

💡 温馨提示:

- 资源需要转存到自己网盘后方可下载

- 推荐使用夸克APP